Klick here for an english Version of this Article

AI Denial - KI Leugner:innen

Angesichts der jüngsten Durchbrüche im Bereich der Künstlichen Intelligenz (KI) sollte man meinen, dass den meisten Menschen klar geworden ist, dass unserer Gesellschaft wirklich fundamentale Veränderungen bevorstehen. Sicher, es gibt immer Ignoranz, aber zumindest die meisten Menschen mit einer wissenschaftlichen oder technischen Ausbildung würden es verstehen? Menschen mit einem gewissen Interesse an Politik würden sich über die Auswirkungen auf unsere Gesellschaft Gedanken machen, oder?

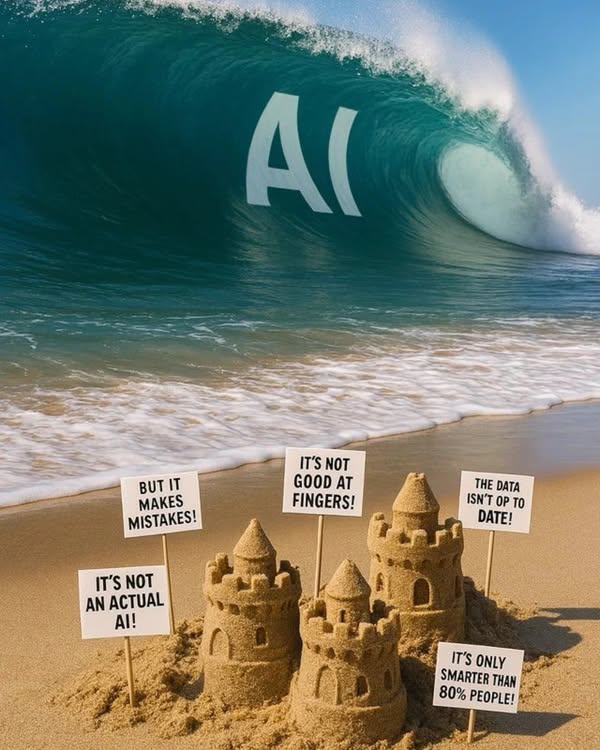

Was mich verwundert, ist, dass selbst fast 3 Jahre nach der Veröffentlichung von ChatGPT es extrem viele Menschen gibt, die es nicht kapieren. Auch intelligente, gebildete Menschen mit einem gewissen politischen Bewusstsein verstehen es nicht. Nicht nur das: Oft wird explizit geleugnet, dass KI unsere Gesellschaft auf den Kopf stellen wird. In diesem Text versuche ich zu erkunden, warum dem so ist.

Vor etwa 25 oder 30 Jahren las Kurzweil und Yudkowsky, die spekulierten, dass KI in einigen Jahren das Niveau menschlicher Intelligenz erreichen könnte. Als IT-Techniker war ich mit Moore's Law vertraut. Die Prognose, dass beim exponentiellen Wachstum die reine Rechenleistung der Hardware etwa im Jahre 2025 die des menschlichen Gehirns erreichen würde, lag auf der Hand. Reine Rechenleistung bedeutet nicht automatisch auch gleiche Intelligenz, denn es bedarf ja auch der entsprechenden Software. Bereits vor 40 Jahren, als ich noch die HTL für Nachrichtentechnik besuchte, lernten wir über neuronale Netze und den Backpropagation-Algorithmus. Dass auch das Problem "Software" damit zu lösen sei, lag für mich auf der Hand. Selbst mit einigen Schwierigkeiten bei der Software könnte das Problem mit der exponentiell wachsenden Leitungsfähigkeit der Hardware gelöst werden. Prognosen sind schwierig, vor allem wenn sie die Zukunft betreffen, aber die damals prognostizierte Entwicklung war mir durchwegs sehr plausibel.

Ähnlich wie beim Klimawandel: Man hätte sich schon seit Jahrzehnten auf das vorbereiten können, was jetzt auf uns zukommt. Zumindest darüber nachzudenken und etwas Planung und Vorbereitung wären nicht schlecht gewesen. Aber viel ist in diese Richtung nicht passiert.

Als ChatGPT im November 2022 herauskam, war ich also nicht wirklich überrascht, sondern es war nur ein Beleg dafür, dass die 20+ Jahre alten Prognosen recht realistisch waren. Meine Erwartung war, dass das als Weckruf für die letzten Zweifler:innen wirken würde.

Sicher, einige Menschen haben die Fähigkeiten des ursprünglichen ChatGPT überschätzt und haben der Technik mehr „Intelligenz“ zugeschrieben, als sie tatsächlich hatte. Es war also auch durchaus sinnvoll, die Beschränktheit dieses Systems aufzuzeigen. Aber zumindest für alle Techniker:innen unter uns hätte klar sein müssen, dass das erst der Anfang war.

ChatGPT und danach auch andere LLM-Systeme gaben nur Antworten aufgrund von „Intuition“, die sich aus dem Training mit großen Datensätzen entwickelt hatte, aber abgesehen von dieser „Intuition" war es kein „Denkprozess". Aber der logische nächste Schritt wäre es, diese „Intuition“ mit einer „Schleife“ zu kombinieren, die die Antworten an das System zurückgibt, um deren Plausibilität zu "überprüfen". Das würde zu einem System führen, das sehr wohl logisch "denken" kann und dies in Kombination mit dem riesigen "Wissen", das es aus dem, in den Gewichten kodierten „Intuitionen“ schöpfen kann. Eine „Intuition" die das gesamte Menschheitswissen umfasst. Genau in diese Richtung ging die Entwicklung: Das ist, was ChatGPT o1 und o3 und anderen "reasoning" Modelle heute machen.

Aber trotz alledem und selbst jetzt, wo wir offensichtlich an der Schwelle zur "Artificial General Intelligence" (AGI - KI auf menschlichem Niveau) stehen, gehen viele Menschen immer noch davon aus, dass das Leben so weitergehen wird, wie sie es kennen. ChatGPT und die Erstellung von Bildern und Videos sind für sie eine nette Kuriosität, aber ansonsten denken sie, dass ihre Jobs recht sicher sind. Vor etwa einem Jahr sagte uns eine Person, die sich mit aktueller KI-Forschung befasst, dass wir uns nur über „narrow AI" (KI, die nur zur Lösung von bestimmten, eng definierten Aufgaben fähig ist) Gedanken machen müssen, aber dass KI auf menschlichem Niveau unmöglich oder vielleicht erst in 300 Jahren möglich sein wird!!!

Wie kann man so blind sein?

Was ist der Grund für AI-Denial?

Unterschätzung von exponentiellem Wachstum

Wir haben das schon in der Corona-Pandemie gesehen: Viele Menschen waren nicht besonders beunruhigt, da es anfänglich nur wenige Fälle gab. Die Tatsache, dass bei exponentiellem Wachstum selbst eine kleine Anzahl von Fällen bald zu einer massiven Katastrophe führen kann, war ihnen nicht bewusst. Man würde erwarten/hoffen, dass technisch und wissenschaftlich gebildete Menschen nicht darauf hereinfallen würden. Aber unser „Hausverstand" neigt dazu, Entwicklungen linear zu extrapolieren: Wenn die Technologie in diesem Jahr so viel kann und vor einem Jahr noch etwas weniger, dann sagt uns die „Intuition", dass wir noch Jahrzehnte von großen Veränderungen entfernt sind.

Der Teich mit Seerosen, in dem sich deren Anzahl jeden Tag verdoppelt und der nach 30 Tagen zu 100% gefüllt ist? Einen Tag zuvor war er nur halb voll. 10 Tage davor nur zu 0.1%.

Die Überschätzung des menschlichen Gehirns

Es scheint, dass manche Menschen unserem Gehirn tatsächlich übernatürliche Kräfte zuschreiben. Das sollte uns nicht wundern, denn das ist ja auch das, was die Religionen uns seit Jahrtausenden predigen. Und das hat wohl auch Spuren im Denken vieler Atheist:innen hinterlassen. Selbst supersmarte Leute wie der Astrophysiker und Nobelpreisträger Roger Penrose behaupten, dass menschliches Bewusstsein nur möglich ist, wenn in jeder menschlichen Gehirnzelle extrem komplexe Quantenprozesse ablaufen, die mit normalen Computern nicht mit vertretbarem Aufwand simulierbar wären.

Aber wenn es nur um Zufall geht: Der spielt auch in allen existierenden LLMs eine wichtige Rolle. Und wenn man tatsächlich „echten" Zufall und nicht nur Pseudo-Random haben will, dann kann man immer auch einen Hardwarezufallsgenerator verwenden. (Das Rauschen an einer 2 Cent teuren Zener-Diode verstärken. Das Rauschen ist direkt verursacht von quantenmechanischen Tunneleffekten.) Und dann stellt sich natürlich die Frage: was überhaupt „Bewusstsein" ist und die ganze Diskussion driftet sehr schnell in philosophische Obskuritäten ab, die wenig damit zu tun haben, welchen Einfluss diese Technologie tatsächlich auf unser Leben haben wird: Braucht das Bewusstsein das "Gefühl in einem Körper zu existieren"? Etc.

Jede hinreichend intelligente KI muss ein Modell der Welt rund um uns haben, und in diesem Modell wird es jedenfalls eine Vorstellung davon geben, was es „selbst" ist. Man kann kein gutes Modell haben, in dem es in der Mitte ein großes schwarzes Loch gibt, das die eigene Existenz darstellt.

Im Übrigen denke ich, dass viele Menschen nicht viel Zeit mit der Erkundung ihres eigenen Verstandes verbracht haben. Auch vieles in unserem eigenen Denken ist sehr „intuitiv" – wir wissen die Antwort auf Fragen, ohne dass wir lange darüber nachdenken müssen. Nur bei schwierigeren Problemen fangen wir an, die Antworten, die uns „intuitiv" in den Sinn kommen, wieder für neue Assoziationen zu nutzen. Oft sind wir verblüfft, wenn unser Verstand mit z. B. optischen Täuschungen oder „psychologischen Tricks" überlistet wird. Ich denke, wir neigen jedenfalls dazu, uns zu überschätzen.

... aber die KI ist nicht menschlich

Das ist ein typisches Argument, das Menschen vorbringen, wenn es um ihren Job geht: Sie müssen mit anderen Menschen kommunizieren und sie brauchen „Gefühle" und „Emotionen", um ihre Arbeit zu erledigen. Und das kann ein Computer niemals leisten. Und ich würde sagen, dass sie damit nicht ganz unrecht haben: Eine KI ist keine menschliche Intelligenz. Zumindest nicht, bis wir eine 1:1-Simulation unserer biologischen Hardware haben. (Vielleicht ist es das, was Penrose meint.) KI ist also, zumindest im Moment, immer eine Art „Alien". Sie ist anders gebaut und in vielerlei Hinsicht anders trainiert.

„Wenn ein Löwe sprechen könnte, wir könnten ihn nicht verstehen.“ schreibt Ludwig Wittgenstein.

Die Kritiker:innen haben hier also recht: Eine AGI ist nicht menschlich. Das heißt aber nicht, dass sie uns nicht bald in allen Bereichen übertreffen wird: Mathematik, Wissenschaft, Technik, Finanzen, Recht usw. Kurioserweise scheinen hier Berufe, die mit physischen Tätigkeiten verbunden sind, noch etwas sicherer. Allerdings nur, wenn man sich nicht darüber informiert hat wie viele Firmen demnächst mit der Serienproduktion humanoider Roboter beginnen wollen. Haben wir erst einmal AGI sind diese Roboter auch in der Lage, sich ebenso wie wir in unserer Welt zurechtzufinden.

Was die Emotionen betrifft: Eine KI wird zwar nicht „verstehen", was es bedeutet, ein Mensch zu sein, weil sie nicht menschlich ist, aber sie wird dennoch in der Lage sein, die meisten Aufgaben zu erledigen, die den Umgang mit menschlichen Emotionen erfordern: das Erkennen von Mikroausdrücken auf einem menschlichen Gesicht oder von subtilen Veränderungen in unserer Stimme, um den emotionalen Zustand eines Menschen zu erkennen? All das wird KI bald besser können als wir. Und ebenso die „Simulation" dieser Emotionen.

Wenn Sie also jetzt z. B. Verkäufer:in sind, der/die sehr gut darin ist, andere Menschen zum Kauf von Dingen zu bringen, die diese nicht brauchen, sollten Sie sich Sorgen um Ihren Job machen.

Aber neue Technologie hat immer auch wieder neue Arbeitsplätze geschaffen.

Schon vor 10 Jahren hat CGP-Grey sein berühmtes YouTube Video veröffentlicht: "Humans need not apply". Wir können immer historische Parallelen für alles finden - bis wir es nicht mehr können. Der "Schwarze Schwan". Das G in AGI steht für "general". Das bedeutet, dass sie alles tun kann, was ein Mensch "allgemein" tun kann. Sie ist nicht spezialisiert. In der Zukunft stellt sich also nicht die Frage: Was kann eine KI und was kann sie nicht, sondern was wir als Menschen tun wollen und was nicht. Zumindest wenn wir dann noch das Sagen haben.

Aber das ist alles ein großer Hype der Tech-Milliardäre

Sicher, diese Leute haben ein Interesse daran, Ihnen neue Technologie zu verkaufen. Sie haben ein finanzielles Interesse daran, zu behaupten, dass dies „die Zukunft“ ist, und daher ein Motiv, die Fähigkeiten ihrer Systeme etwas zu übertreiben. Aber letzten Endes: All das Geld, das auf Grund dieses "Hypes" in die KI Technologie fließt, wird nur die Geschwindigkeit erhöhen, mit der sie entwickelt wird. Es ist also ein bisschen wie eine sich selbst erfüllende Prophezeiung.

Manche bemühen den Vergleich mit der dot.com Blase, die 2001 platzte: Aber wie wir sehen, hat das Platzen der Blase das Internet nicht davon abgehalten, unsere Gesellschaft zu verändern.

Aber diese Entwicklungen gefallen uns nicht!

Das stimmt. Mir gefällt es auch nicht. In der Tat: Mit kapitalistischen und imperialistischen Interessen, die auch hinter der Entwicklung von KI stecken, sollten wir uns große Sorgen machen! Alle Probleme, die wir in unserer heutigen Gesellschaft haben - Rassismus, Sexismus, Frauenfeindlichkeit usw. - können durch diese neue Technologie sehr leicht verstärkt werden.

Ich stimme voll und ganz zu: Diese Technologie kann extremen Schaden anrichten und sollte absolut nicht von Macht- und Profitinteressen geleitet werden. Aber genau das wäre ein Grund mehr, warum wir die Bedeutung dieser Entwicklungen nicht unterschätzen oder herunterspielen sollten. Nur wenn genügend Menschen sich der grundlegenden Veränderungen bewusst sind, die diese neue Technologie mit sich bringen wird, und nur wenn sie sich bewusst sind, wie schnell dies geschehen wird, besteht noch eine Chance, den Lauf der Geschichte hier noch zu verändern.

Die Vorstellung, dass dies alles nicht passieren wird, wenn wir einfach die Augen schließen und so tun, als ob wir es nicht sehen, ist wirklich absurd. Doch genau das ist anscheinend unter Linken der Hauptgrund für die KI‑Leugnung. Weil uns die Ideologie der kapitalistischen Tech-Giganten nicht gefällt, tun wir so, als würde das alles nicht passieren.

Das „Overton Window“– Niemand will als verrückter Spinner dastehen

Wenn man über die grundlegenden Veränderungen spricht, die mit AGI und ASI auf uns zukommen, dann klingt das sehr nach Science-Fiction. Selbst Menschen, die sich bewusst sind, dass viele dieser Entwicklungen mit einer hohen Wahrscheinlichkeit eintreten werden, haben Angst, als Spinner dazustehen, wenn sie zu offen darüber sprechen.

Vor allem im Bereich der Wissenschaft scheint das doch sehr ausgeprägt zu sein. Als Google im Jahre 2012 Ray Kurzweil als Forschungsleiter einstellte, hatte ich etwas Hoffnung, dass sich das ändern würde. Zumindest als Geoffrey Hinton 2023 zu Wort meldete und später Nobelpreisträger wurde, dachte ich, dass damit das Eis gebrochen wäre. Aber wie es scheint: noch nicht wirklich.

Wir gestehen nur ungern unsere Fehler ein

Im Laufe dieser Debatte haben sich einige Leute auf die oben erwähnten Positionen zurückgezogen. Einen Fehler einzugestehen, ist oft nicht einfach. Also versuchen die Leute, ihre Positionen zu rationalisieren und Argumente zu finden, warum sie trotzdem „richtig" lagen. Es fehlt hier leider an intellektueller Redlichkeit.

Man könnte also argumentieren: Es spielt keine große Rolle: Innerhalb der nächsten 1 oder 2 Jahre werden wir ohnehin sehen, was AGI wirklich kann. Hauptproblem ist: Wir sollten bereits jetzt für die politische Kontrolle von KI und für ein universelles Grundeinkommen (UBI) und letztlich für die Überwindung des Kapitalismus eintreten. Wir dürfen nicht noch mehr Zeit verlieren, unsere politischen Forderungen aufzustellen und durchzusetzen.

Franz Schaefer (Mond). Mai 2025.